Quando l’AI dà le allucinazioni

Di cosa si tratta? Scopriamolo insieme, con tutti i rischi tecnici e legali che comportano.

Grandi passi avanti, grandi sfide

Negli ultimi anni, l'intelligenza artificiale (AI) ha fatto passi da gigante, rivoluzionando gradualmente tutti i settori. Insieme a questi avanzamenti, però, emergono anche nuove sfide e preoccupazioni. Uno dei problemi più insidiosi è ad esempio quello delle "allucinazioni" delle AI. Questi episodi possono avere conseguenze significative sia sul piano tecnico che legale, rendendo fondamentale un approccio prudente e consapevole all'uso di queste tecnologie.

Ma cosa sono le allucinazioni delle AI?

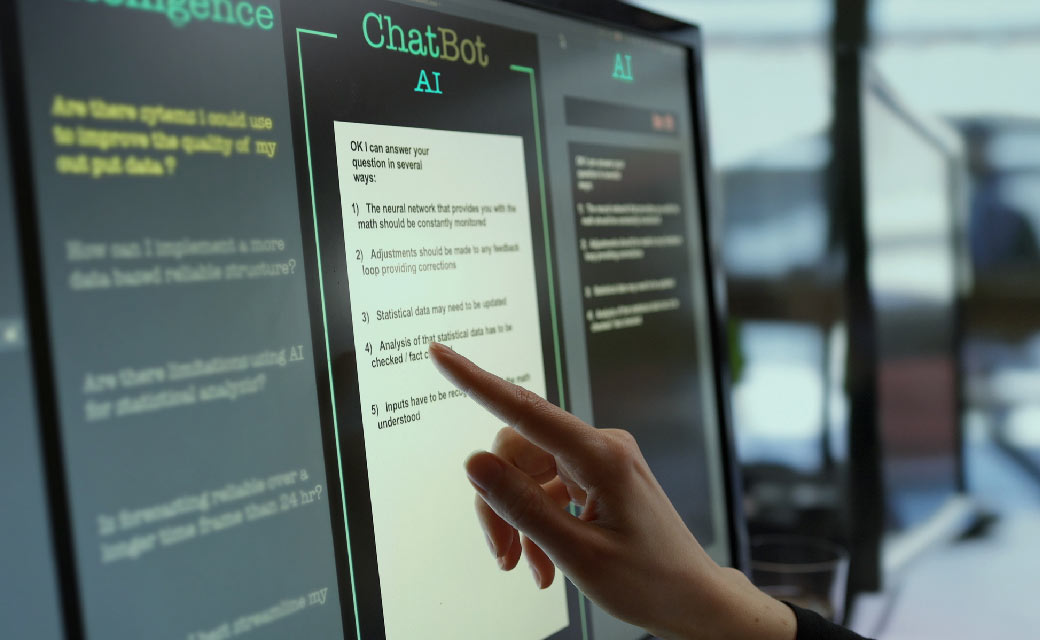

Le allucinazioni delle AI si verificano quando un sistema di intelligenza artificiale genera informazioni errate o inesistenti, che tuttavia appaiono plausibili e convincenti. Ad esempio, un chatbot potrebbe fornire una risposta completamente inventata a una domanda, oppure un sistema di riconoscimento delle immagini potrebbe identificare erroneamente un oggetto.

Questi errori non sono semplici bug, ma derivano spesso da problemi nei dati addestramento, che influenzano negativamente la capacità del modello di generalizzare correttamente. Inoltre, la complessità degli algoritmi di machine learning può portare a interpretazioni sbagliate dei dati, specialmente quando il modello cerca di colmare lacune nelle informazioni disponibili.

Per mitigare un po’

Evitare che le allucinazioni avvengano è una sfida complessa, ma dalle prime versioni delle AI generative rilasciate sono stati fatti progressi significativi.

Ecco alcune delle strategie più promettenti:

- Miglioramento dei dati di addestramento

Garantire che i dati utilizzati per addestrare le AI siano il più accurati e rappresentativi possibile riduce il rischio di allucinazioni.

- Validazione e verifica

Implementare rigorosi protocolli di verifica dei risultati prodotti dalle AI può aiutare a individuare e correggere le allucinazioni prima che causino danni.

- Interventi umani

Mantenere l'intervento umano come parte integrante del processo decisionale delle AI può mitigare il rischio di allucinazioni, soprattutto in ambiti critici come la sanità e la finanza.

- Tecniche di explainability

Sviluppare modelli di AI più trasparenti che permettano di comprendere come vengono prese le decisioni può aiutare a identificare e correggere potenziali errori.

Un problema anche legale

Le allucinazioni delle AI non sono solo un problema tecnico, ma sollevano anche importanti questioni legali. Ecco alcuni esempi dei rischi possibili:

- Responsabilità

Chi è responsabile se un'AI provoca danni a causa di un'allucinazione? Questa domanda è al centro di molte discussioni legali e non ha ancora una risposta chiara. Finché non si troverà un vero “colpevole”, le aziende che sviluppano o utilizzano AI potrebbero trovarsi a dover affrontare cause legali e richieste di risarcimento.

- Danni reputazionali

Le allucinazioni delle AI possono danneggiare la reputazione delle aziende, soprattutto se diffondono informazioni false o fanno prendere decisioni sbagliate. Questo può avere un impatto significativo sulla fiducia dei consumatori.

- Conformità normativa

Con l'introduzione di normative sempre più stringenti in materia di AI, le aziende devono garantire che i loro sistemi siano conformi. Le allucinazioni possono comportare violazioni delle normative, esponendo le aziende a sanzioni.

- Privacy

Le allucinazioni possono portare alla divulgazione di dati sensibili o alla violazione della privacy degli utenti, con conseguenze legali rilevanti.

AI: usare con cautela

Un uso troppo disinvolto delle AI generative può comportare gravi rischi e conseguenze imprevedibili: le allucinazioni rappresentano una minaccia concreta che può minare la fiducia degli utenti e causare danni significativi. Senza un adeguato controllo e una supervisione rigorosa, queste tecnologie possono diffondere disinformazione, compromettere la privacy e portare a decisioni aziendali errate con potenziali ricadute legali.

Quindi, in attesa di miglioramenti significativi su questo aspetto delle AI generative, è fondamentale adottare un approccio cauto e responsabile, investendo in misure di mitigazione e nella verifica continua dei risultati prodotti dalle AI, per evitare di cadere nelle sue insidie.

Desideri una consulenza personalizzata?

Contattaci per valutare insieme la soluzione più adatta alle tue esigenze.

Il mondo della tecnologia ti incuriosisce? Te lo raccontiamo nella nostra newsletter: iscriviti!

Il mondo della tecnologia ti incuriosisce? Te lo raccontiamo nella nostra newsletter: iscriviti!